Le mythe de la Singularité technologique

Publié en ligne le 4 septembre 2020 - Intelligence Artificielle -

Signée par quatre scientifiques éminents, Stephen Hawking, astrophysicien renommé, Stuart Russell, informaticien, professeur à l’université de Californie à Berkeley et auteur d’un manuel sur l’intelligence artificielle qui fait autorité, Max Tegmark, physicien et professeur au MIT et Frank Wilczek, physicien, professeur au MIT et Prix Nobel de physique, une tribune alarmiste a paru le 1er mai 2014 dans le journal The Independent [1] pour nous alerter sur des dangers que l’intelligence artificielle ferait courir à l’humanité. Selon ces quatre personnalités, nous atteindrions très bientôt un point de non-retour au-delà duquel nous irions inéluctablement à notre perte sans plus jamais pouvoir revenir en arrière. Aujourd’hui, il serait encore temps ; demain, plus rien ne sera possible !

Cet appel à la vigilance fut suivi de beaucoup d’autres lancés par les mêmes, par exemple par Stephen Hawking à la BBC ou par Stuart Russel qui a parrainé en 2015 deux lettres ouvertes publiées sur le site de l’Institut du futur de la vie, l’une sur les dangers de l’intelligence artificielle [2], l’autre sur les méfaits potentiels des armes autonomes [3], ou par d’autres, qu’il s’agisse de philosophes, comme Nick Bostrom [4], ou d’hommes d’affaires très en vue comme Elon Musk et Bill Gates. Partout dans le monde, ces personnalités font des émules. En France, c’est le cas de Laurent Alexandre, médecin et homme d’affaire très médiatique [5, 6] et d’un philosophe qui s’est spécialisé dans le transhumanisme, Jean-Michel Besnier [7]. En l’occurrence, ce dernier se demandait dans une émission de radio [8] si l’Homme était encore maître de l’intelligence artificielle. À l’appui de sa thèse, il mentionnait « le pilotage assisté des avions » et les « robots traders » à la Bourse qui, les uns et les autres, auraient « dessaisi [l’Homme] du pouvoir d’intervenir ».

Basculement vers la transhumanité

Ces déclarations publiques annoncent toutes un événement majeur et inquiétant consécutif à l’utilisation massive des technologies de l’information. Elles font frémir lorsqu’elles en décrivent les conséquences dramatiques pour l’humanité, l’imminence et l’inéluctabilité. Ces trois points relèvent de scénarios catastrophes venant tout droit de la science-fiction, par exemple des romans de Vernor Vinge publiés dans les années quatre-vingt et de son essai intitulé The coming technological singularity (« La singularité technologique à venir ») paru en 1993 [9]. Tentons ici d’en analyser la vraisemblance.

Conséquences pour l’humanité

Commençons par les supposées conséquences dramatiques pour l’humanité dans son ensemble. Aux dires de Stephen Hawking et d’Elon Musk, le déploiement des technologies d’intelligence artificielle sur des ordinateurs hyperpuissants constitue « notre plus grande menace existentielle » [10], car les humains ne pourront plus rivaliser avec des machines devenues plus intelligentes qu’eux. Ces machines ultra-intelligentes entreront en rébellion contre nous, prendront le pouvoir et nous réduiront en esclavage. Cela signifie que les robots que nous fabriquerons auront des désirs, des aspirations, des besoins distincts des nôtres et de ceux que nous leur avons insufflés, autrement dit qu’ils se constitueront en sujets autonomes agissant pour eux-mêmes et doués d’une volonté propre. Beaucoup s’inquiètent, avec cette fin de la prééminence de l’être humain dans la nature, d’une évolution négative ; quelques autres perçoivent les choses différemment : ils y voient une perspective salutaire.

Ainsi pour Ray Kurzweil (directeur de l’ingénierie chez Google) et pour les tenants de « l’intelligence artificielle amicale » (friendly AI, terme introduit en 2008 [11]) il y aurait là un espoir inouï car, loin de conduire à la fin de sa prééminence, cette catastrophe offrira à l’humanité une opportunité inédite de mutation grâce à laquelle, par couplage à des ordinateurs, les femmes et les hommes deviendront des surhommes, voire de pures consciences qui, dégagées de leur gangue biologique, c’est-à-dire de leur corps, continueront de vivre une existence toute spirituelle sur les réseaux.

Inéluctabilité et imminence

Le deuxième point porte sur l’inéluctabilité de cet événement catastrophique, ce qui suppose, implicitement, que les technologies se déploient de façon autonome, indépendamment de nous, et qu’en conséquence nous ne pouvons plus rien à cette évolution qui se produit par-devers nous. Cela signifie que les hommes ne seraient plus libres, puisqu’ils n’auraient plus prise sur leur destin, quoi qu’il advienne.

Cette inéluctabilité se conjugue avec l’imminence qui découlerait, selon certains auteurs comme Raymond Kurzweil [12], d’un calcul mathématique issu de l’extrapolation de la loi de Moore. Rappelons que cette loi, émise en 1964, par Gordon Moore, le fondateur de la société Intel, est une loi d’observation qui montre que, depuis 1959, les performances des processeurs doublent tous les deux ans ou tous les dix-huit mois selon les formulations, ce qui correspond à un rythme d’évolution exponentiel. Si cette loi se prolongeait indéfiniment, nous atteindrions, avec le temps, une puissance sans limite des ordinateurs, ce qui paraît contraire tout à la fois à l’intuition et aux lois de la physique. C’est pourtant sur l’extrapolation de cette loi d’observation que certains se fondent pour affirmer que les ordinateurs nous dépasseront très bientôt.

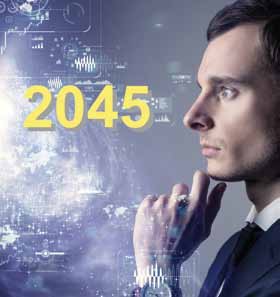

Ainsi, Ray Kurzweil affirme que ce sera pour 2045 [13]. Le caractère exponentiel de cette loi laisse présager, à partir d’un certain point, l’existence d’un changement brusque au-delà duquel rien ne serait plus comme avant. C’est ce que Ray Kurzweil nomme la « Singularité technologique », avec un « S » majuscule pour signifier son unicité et son exceptionnalité. Or, cette inflexion majeure découle d’une observation considérée comme une loi certaine et immuable et dont nous connaîtrions l’équation.

Une citation de Ray Kurzweil résume parfaitement cela : « Une analyse de l’histoire des technologies montre que le changement technologique est exponentiel, contrairement à la vision “linéaire intuitive” de bon sens. Ainsi, au rythme actuel, ce ne sont pas cent ans de progrès que nous connaîtrons au XXIe siècle, mais plutôt 20 000 ans. Les “retours” sur des éléments tels que la vitesse des processeurs ou leurs coûts de fabrication augmentent également de manière exponentielle. Il y a même une croissance exponentielle du taux de croissance exponentiel. D’ici quelques décennies, l’intelligence des machines dépassera l’intelligence humaine, ce qui conduira à La Singularité – un changement technologique si rapide et si profond qu’il représente une rupture dans la trame de l’histoire humaine. Il s’ensuivra la fusion de l’intelligence biologique et non biologique, l’immortalité humaine réalisée sur des logiciels et l’accès à des niveaux d’intelligence ultra-élevés qui se déploieront vers l’extérieur de l’univers à la vitesse de la lumière » [14].

La preuve par les capacités du « deep learning »

Le dernier argument avancé par les tenants de la Singularité renvoie à l’extraordinaire capacité des machines entraînées par apprentissage profond sur d’immenses bases de données. Elles l’emportent déjà sur les meilleurs joueurs mondiaux au jeu de go, elles diagnostiquent les maladies mieux que des médecins, elles reconnaissent la parole et les visages, elles anticipent certains de nos désirs avant que nous en soyons conscients, etc. Comment s’empêcher de penser qu’un jour, sachant la supériorité de ces machines, nous préférerons leur confier les tâches importantes, par exemple établir des diagnostics médicaux, prendre des décisions politiques ou rendre des jugements et ainsi leur déléguer nos responsabilités. Dès lors, c’en sera fini de notre liberté ! J’appellerai ce dernier argument « Harari », du nom de Yuval Noah Harari, un auteur israélien qui a exposé cette thèse dans un livre à très grand succès intitulé Homo Deus [15].

Réfutations

L’intelligence artificielle étant une science, et étant moi-même un scientifique chercheur travaillant dans ce domaine depuis de nombreuses années, il m’est apparu important d’analyser ces arguments à la lumière de la réalité scientifique contemporaine de cette discipline.

La scientificité de l’intelligence artificielle

Commençons d’abord par rappeler que l’intelligence artificielle est officiellement née en 1956, au Dartmouth College, dans la ville d’Hanover aux États-Unis, lors d’une école d’été organisée par quatre chercheurs, John McCarthy, Marvin Minsky, Nathanael Rochester et Claude Shannon, qui souhaitaient créer une nouvelle discipline scientifique visant à mieux comprendre l’intelligence en en reproduisant les différentes composantes à l’aide d’ordinateurs. Leur projet reposait sur la conjecture selon laquelle toutes les facultés cognitives, en particulier le raisonnement, le calcul, la perception, la mémorisation, voire la découverte scientifique ou la création artistique, pourraient être décrites avec une précision telle qu’il devrait être possible de les simuler à l’aide d’une machine.

Il s’agit donc d’une discipline scientifique empirique qui conçoit des modèles et les valide expérimentalement. En outre, ces simulations de nos différentes fonctions cognitives s’intègrent à de nombreux dispositifs technologiques pour rendre des services considérables. Soixante quatre ans plus tard, en dépit des progrès époustouflants enregistrés et des innombrables applications pratiques réalisées ou envisagées, l’étude de l’intelligence artificielle repose toujours sur la même conjecture que rien, jusqu’à présent, n’a permis ni de démentir, ni de démontrer irréfutablement.

Réfutation de l’argument « Kurzweil »

Ainsi, pour l’instant, les scientifiques ne savent pas comment procéder pour concevoir des machines dotées d’une intelligence générale capable de dépasser l’Homme. Et, de plus, on est loin de comprendre les mécanismes à l’origine de la conscience entendue comme la faculté d’éprouver des émotions et de la volonté. Ces prédictions reposent donc sur l’anticipation de la capacité de calcul et de stockage des machines calculée à partir de leur fréquence et du nombre de composants qu’elles contiennent, et dont on suppute qu’avec le temps, elle deviendrait équivalente, puis supérieure à celle du cerveau humain. Je nommerai cet argument « l’argument Kurzweil » en référence au nom de Ray Kurzweil, car il l’a mentionné à maintes reprises dans ses nombreux ouvrages, comme en témoignent les titres des principaux d’entre eux 1.

Commençons par analyser l’argument de Ray Kurzweil selon lequel les machines vont très bientôt nous dépasser et acquérir une conscience du fait de l’augmentation de leur puissance, ce qui constituerait un « risque existentiel » pour l’humanité.

Sans doute, l’accroissement des capacités de calcul des machines a permis, ces dernières années, à l’intelligence artificielle de réaliser des prouesses sur des tâches spécifiques, comme les jeux (jeu de go ou poker), la reconnaissance faciale, la reconnaissance de la parole ou la conception de voitures autonomes. Cependant, la loi de Moore, qui est à l’origine de l’idée même de Singularité, commence à s’essouffler. Elle est due en grande partie à la miniaturisation des composants électroniques qui s’est poursuivie de façon régulière depuis soixante-dix ans. Or, les technologies du silicium atteindront bientôt des limitations physiques liées, en particulier, à la taille des atomes, limite en deçà de laquelle on ne pourra plus miniaturiser. Certains évoquent d’autres technologies, comme l’utilisation du graphène ou de microfibres de carbone, ou encore le calcul quantique. Mais, même si rien ne s’oppose à ce que ces technologies prennent le relais du silicium pour contribuer à la réalisation de processeurs informatiques plus puissants, aujourd’hui, rien ne permet de l’assurer.

Qui plus est, même si cette augmentation des capacités des machines se poursuivait, la quantité de stockage d’information et la rapidité de calcul ne produisent pas à elles seules de l’intelligence et a fortiori une « conscience émotionnelle » ou une intentionnalité, loin s’en faut !

Bref, même s’il n’est pas possible de réfuter totalement ce scénario en prouvant son impossibilité, il n’existe pas non plus d’argument tangible pour démontrer qu’il est plus probable que des myriades d’autres avec lesquels il n’a jamais été confronté.

Réfutation de l’argument « Harari »

Nous venons de voir que l’argument de Ray Kurzweil était peu crédible, en dépit de sa popularité dans les médias. D’autres tenants de la Singularité technologique comme Yuval Noah Harari évoquent l’apprentissage automatique (machine learning) dont les progrès récents laissent songeur. D’après eux, même si les machines ne prennent pas leur autonomie propre au sens où elles n’ont pas d’intentionnalité, nous serions tout de même enclins, pour des raisons pratiques, à leur confier nombre de tâches usuelles, par exemple l’établissement d’un diagnostic médical ou le déploiement des forces de police ou encore la sentence à attribuer à un prévenu, car elles se révéleront très bientôt plus avisées que nous. Il s’ensuivrait une perte de responsabilité et, surtout, une absence de liberté.

Cependant, un examen approfondi des techniques d’apprentissage automatique les plus utilisées aujourd’hui, à savoir l’apprentissage supervisé ou l’apprentissage par renforcement, montre qu’elles reposent soit sur un étiquetage des exemples, soit sur une fonction de récompense. Or, tant l’étiquetage des exemples que la récompense sont donnés par des êtres humains. L’apprentissage consiste donc en une compression du savoir humain qui peut se révéler plus efficace que celui des hommes dans l’exécution de certaines tâches, mais pas sur l’intégralité de son activité. De plus, l’histoire des sciences d’un côté et la psychologie développementale de l’autre nous enseignent que la construction du savoir tant individuel que collectif passe par certaines phases de basculement comme les changements de paradigmes ou les ruptures épistémologiques ou encore les stades de développement cognitif. Or, jusqu’à aujourd’hui, les machines ne sont pas en mesure de remettre en cause les représentations qui leur ont été fournies et donc de procéder par elles-mêmes à de tels basculements d’appareils conceptuels.

Conclusion

Les théories de la Singularité technologique et les autres annonces, catastrophistes ou enthousiastes, lancées par des célébrités, chercheurs, hommes d’affaires ou ingénieurs, se révèlent, à l’analyse, bien peu fondées sur le plan scientifique. Nous avons essayé ici de résumer assez rapidement les faiblesses des arguments sur lesquelles elles prétendent reposer. Ce qui importe, c’est que de tels arguments ne relèvent pas de la science à proprement parler, même si leurs partisans le prétendent et si certains d’entre eux sont même des scientifiques ou des ingénieurs. En cela, bien plus que de science, il s’agit de déclarations fantaisistes qui s’appuient sur des sciences fictives, c’est-à-dire sur des pseudo-sciences. Et, ici comme ailleurs, il ne faut pas se laisser abuser par les arguments d’autorité et la position sociale de leurs zélateurs.

1 | Hawking S et al., “Transcendence looks at the implications of artificial intelligence – but are we taking AI seriously enough ?”, The Independent, 1er mai 2014. Sur independent.co.uk

2 | “Research Priorities for Robust and Beneficial Artificial Intelligence : An Open Letter”. Sur futureoflife.org

3 | “Autonomous Weapons : An Open Letter from AI & Robotics Researchers”. Sur futureoflife.org

4 | Bostrom N, Superintelligence : Paths, Dangers, Strategies, Oxford University Press, 2014.

5 | Alexandre L, La mort de la mort, JC Lattès, 2011.

6 | Alexandre L, La guerre des intelligences, JC Lattès, 2017.

7 | Besnier J-M, Demain les posthumains, Hachette Littérature, 2009.

8 | Émission de France Info, « L’Homme est-il encore maître de l’intelligence artificielle ? », 25 décembre 2014. Sur franceinfo.fr

9 | Vinge V, « The coming technological singularity », in : Landis GA (éd.), Vision-21 : Interdisciplinary Science and Engineering in the Era of Cyberspace, NASA Publication CP-10129, 1993, p. 115-26.

10 | Morris DZ, “Elon Musk Says Artificial Intelligence Is the ‘Greatest Risk We Face as a Civilization’”, 15 juillet 2017.

11 | Yudkowsky E, “Artificial Intelligence as a Positive and Negative Factor in Global Risk”, in : Bostrom N, Cirkovic MM (éds.), Global Catastrophic Risks, Oxford University Press, 2008.

12 | Kurzweil R, The Singularity Is Near : When Humans Transcend Biology, Viking, 2005.

13 | Reedy C, “Kurzweil Claims That the Singularity Will Happen by 2045. Get ready for humanity 2.0”, 5 octobre 2017. Sur futurims.com

14 | Kurtzweil R, “The Law of Accelerating Returns”, 2001. Sur kurzweilai.net

15 | Harari YN, Homo Deus : A Brief History of Tomorrow, Vintage, 2017.

1 Comment créer un esprit : le secret de la pensée humaine révélé (2013), L’âge des machines spirituelles : quand les ordinateurs l’emportent sur l’intelligence humaine (2000), Transcendance : neuf étapes pour vivre mieux éternellement (2010), La Singularité est proche : quand les humains transcendent la biologie (2006), Humain virtuel : la promesse – et le danger – de l’immortalité numérique (2014), Voyage fantastique : vivre suffisamment longtemps pour vivre éternellement (2005). Traduction en français par nos soins.

Publié dans le n° 332 de la revue

Partager cet article

L' auteur

Jean-Gabriel Ganascia

Professeur à la Faculté des sciences de Sorbonne Université. Depuis 1988, il dirige l’équipe Acasa (Agents (...)

Plus d'informationsIntelligence Artificielle

L’intelligence artificielle (IA) suscite curiosité, enthousiasme et inquiétude. Elle est présente dans d’innombrables applications, ses prouesses font régulièrement la une des journaux. Dans le même temps, des déclarations médiatisées mettent en garde contre des machines qui pourraient prendre le pouvoir et menacer la place de l’Homme ou, a minima, porter atteinte à certaines de nos libertés. Les performances impressionnantes observées aujourd’hui sont-elles annonciatrices de comportements qui vont vite nous échapper ?

Intelligence artificielle

Le 16 août 2020

IA génératives : une révolution en cours ?

Le 17 octobre 2023

De l’analyse de la langue aux modèles génératifs

Le 11 octobre 2023

Les systèmes d’intelligence artificielle pour la génération d’images

Le 5 octobre 2023

IA génératives : un risque accru de désinformation ?

Le 29 septembre 2023