Les congrès sur le peer review

Publié en ligne le 14 août 2018 - Information scientifique -Si les premières revues de sociétés savantes datent de la fin du XVIIe siècle, c’est au début du XXe siècle qu’elles se sont largement développées. Elles avaient à l’origine trois missions principales :

- permettre aux chercheurs de prendre date sur les résultats de leurs travaux,

- diffuser le savoir produit,

- enfin, servir d’archives pérennes.

Après la seconde guerre mondiale, devant le très grand nombre d’articles reçus, certaines prestigieuses revues anglaises ont mis en place un processus de sélection. Elles ont ainsi progressivement développé une quatrième mission consistant à évaluer la qualité des textes soumis pour n’en publier que les meilleurs. Des experts ont été sollicités afin d’éclairer les décisions des comités de rédaction. Cette évaluation, ou revue externe par des pairs, est maintenant appelée peer review, terminologie généralement adopté dans toutes les langues. Le peer review s’est généralisé à la plupart des revues dans les années 1970.

Le peer review et ses dérives devient un objet d’étude et de recherche

Dans le même temps où le peer review était mis en place, les institutions de recherche et les universités se sont progressivement appuyées sur la mesure du nombre d’articles publiés dans les revues pour décider de l’allocation des financements entre équipes. Elles ont également utilisé cet indicateur pour évaluer les chercheurs et décider de leur promotion.

De leur côté, les revues ont commencé une course à la recherche de publications innovantes en privilégiant les articles dits « positifs », c’est-à-dire avec des résultats statistiquement significatifs. Tous les acteurs ont compris qu’il fallait innover, oubliant que la science, c’est aussi reproductibilité, lenteur, qualité, hypothèses… Une recherche reproduisant des résultats connus n’intéressait personne… alors que c’est parfois le fondement de la science reproductible. Les premiers scandales sont apparus en Amérique du Nord, avec des fraudes visant à rendre positifs des résultats qui ne l’étaient pas. Les revues ont été accusées de ne pas les détecter… mais elles ont répondu que ce n’était pas leur mission, et qu’elles n’en avaient de toutes les façons pas les moyens.

Des rédacteurs (c’est-à-dire des membres des comités de rédaction) américains et anglais, dans un premier temps essentiellement issus de la biomédecine, se sont interrogés sur le peer review, ce processus lent, consommateur de temps de chercheurs bénévoles et objet de suspicions. Ainsi, l’anonymat des relectures a été parfois accusé de conduire à des dérives comme le vol d’idées ou des avis volontairement biaisés pour nuire aux concurrents. Sous l’égide de rédacteurs de deux revues médicales (Journal of the American Medical Association à Chicago, et British Médical Journal à Londres), il a été proposé d’initier des recherches sur le fonctionnement même du système de publication scientifique. Avant les années 1990, ce type de recherche était rare, voire impossible : résistance des acteurs à mettre en place des protocoles d’étude, pouvoir et puissance non contestables des rédacteurs, absence de motivation et de financements…

Le premier congrès s’est tenu en 1989 à Chicago avec moins de 300 personnes [1]. Il s’est ensuite réuni tous les quatre ans et la huitième session a regroupé plus de 600 participants en septembre 2017 à Chicago. Si la première conférence de 1989 a donné lieu à 25 sessions pour 50 présentations (dont 3 % faites par des femmes), celle de 2017 a accueilli 24 sessions plénières pour 260 présentations (dont 58 % faites par des femmes). Les disciplines des chercheurs étaient biomédicales au début, mais avec le temps d’autres domaines scientifiques (sciences dites dures, sciences sociales) ont envoyé des rédacteurs. La recherche, bien que difficile, a progressé. Par exemple le mot-clé « peer review » dans la base de données PubMed donne accès à 317 articles en 1989 et 2 983 articles en 2017. La qualité méthodologique a également progressé.

Une évolution des thèmes traités

Dans les années 1990, les congrès ont mis en évidence un certain nombre de faits comme des fonctionnements très différents selon les revues, la grande difficulté à détecter les articles frauduleux ou l’existence de différents types de peer review. Les arguments pour l’anonymat des relecteurs étaient nombreux : qualité des évaluations non biaisée, jeunes chercheurs pouvant donner des avis sans crainte pour leur carrière, etc. Deux modèles ont été comparés : le peer review dit « simple aveugle » (le relecteur connaît l’auteur, l’auteur ne connaît pas le relecteur) et le modèle dit « double aveugle » (le relecteur ne connaît pas l’auteur, l’auteur ne connaît pas le relecteur). Pour le double aveugle, tout élément de reconnaissance des auteurs doit être éliminé… et ce n’est pas toujours facile. Des discussions se sont également développées sur des thèmes tels que les critères de choix des relecteurs, les pratiques de ces derniers ou encore les multiples conflits d’intérêts des acteurs. Le peer review lui-même commençait à être évalué avec de vraies études comparatives menées au sein des revues. Les chercheurs jeunes (moins de 45-50 ans) semblaient être les meilleurs relecteurs. Tous les travers d’un système tendant à privilégier ses amis et rejeter ses ennemis étaient discutés sans que de réelles solutions soient apportées.

La conclusion de l’époque reste entièrement valide en 2018 : le peer review a tous les défauts, les preuves de son utilité sont encore fragiles, mais il n’existe pas de meilleur système pour évaluer les articles !

Par ailleurs, beaucoup d’études se sont intéressées au profil des acteurs. Sans surprise, on a constaté une prédominance masculine pour les auteurs et les rédacteurs. Très peu de femmes (voire aucune ?) occupaient des positions de rédacteur en chef dans les années 1990. Des recherches ont aussi montré que former les relecteurs n’avait pas de réel impact sur la qualité de l’évaluation.

Dans les années 2000, les technologies numériques vont complètement révolutionner le monde de la publication scientifique et les éditeurs en place ont progressivement intégré ces innovations. Mais surtout, de très nombreuses revues sans support papier et en libre accès sont apparues. Le modèle économique a aussi changé avec la participation des auteurs au financement et la diminution des recettes issues des abonnements. Peu de recherches ont été conduites sur les avantages et inconvénients de ce nouveau modèle économique. Avec ces nouvelles revues, dont les leaders étaient les groupes PLOS et BioMedCentral s’est également mis en place un « peer review ouvert » où les auteurs connaissent les noms des relecteurs. Les débats suscités ont été virulents, certains accusant l’ancien modèle d’évaluation reposant sur l’anonymat d’être obscur et non éthique. Des études ont montré que le modèle dit ouvert pouvait fonctionner aussi bien que les autres. Mais, malgré cela, le peer review dit aveugle (simple ou double) reste prépondérant.

Dans les années 2010, des pratiques discutables ont été identifiées par les revues, en particulier la manipulation d’images par des auteurs d’articles publiés dans des revues prestigieuses. Des études ont mis en évidence le comportement d’auteurs cherchant à satisfaire les attentes des revues, friandes d’innovation. La présence de « spins » (la conclusion des auteurs va bien au-delà de ce que permettent les observations 1) a été bien documentée, et l’utilité de la diffusion de lignes directrices pour aider à l’écriture des articles a été prouvée. Du côté des revues, les rédacteurs ont amélioré leurs méthodes pour identifier les malveillances et les fraudes ; ils ont précisé les mécanismes de corrections, d’expressions de réserves et de rétractation. Ainsi, par exemple, quand un article est rétracté, il reste en ligne pour assurer la continuité de l’archivage mais contient la mention « retracted » bien visible.

Enfin, des études ont mis en évidence la très forte prévalence dans la littérature des résultats dits « positifs » (qui montre un effet ou qui confirment une hypothèse) au détriment de ceux dits « négatifs » (qui échouent à montrer un effet ou confirmer une hypothèse) bien qu’ils aient un intérêt scientifique similaire. R Horton, rédacteur en chef de The Lancet, a suggéré que la moitié des publications seraient « embellies », voire fausses pour parvenir à ce résultat [2].

La communauté des rédacteurs veut réagir pour promouvoir plus d’intégrité, mais elle sait que les revues, seules, ne pourront apporter la solution. Elle a été très engagée dans les mouvements pour l’intégrité de la science et aimerait que les évaluations des chercheurs et des laboratoires s’éloignent des seuls indicateurs quantitatifs pour privilégier des indicateurs qualitatifs.

Lors du dernier congrès du peer review qui s’est tenu en 2017, les thèmes qui vont nécessiter de nouvelles études ont été discutés. Ils concernent :

- les explications que l’on peut apporter à la mauvaise reproductibilité des résultats publiés ;

- la manière de détecter les faux relecteurs qui réussissent à biaiser le peer review ;

- le dépôt des résultats de recherche sur des archives ouvertes, avec une dissémination qui se fait avant l’évaluation en peer review (accélérer la diffusion des résultats présente-t-il un risque ?) ;

- la participation de patients dans des comités de rédaction de revues médicales (elle a été testée avec succès au sein de quelques revues et pose la question plus générale de l’ouverture des comités de rédactions à des non-chercheurs) ;

- les fausses revues dites « revues prédatrices » dont le volume pourrait menacer le système de diffusion des connaissances (comment lutter contre ?).

Le chantier des compétences des rédacteurs doit également être abordé dans les années à venir : la plupart du temps, une société savante nomme un comité de rédaction sur des compétences scientifiques, et devenir rédacteur est une sorte de récompense pour des chercheurs éminents. Mais ces rédacteurs n’ont pas de réelles compétences pour gérer une revue.

Que conclure ? Tout d’abord, que la plupart des recherches ont été faites dans les pays anglo-saxons et au sein des revues prestigieuses. Peu de recherches ont porté sur les revues de spécialités. La présence française aux congrès de peer review reste très faible (moins de dix personnes à chaque congrès). Les financements pour faire de la recherche sur la recherche sont récents et ce n’est que depuis les années 2010 que des fondations, essentiellement américaines, ont apporté des ressources. En 2018, environ dix équipes ont les moyens de faire des recherches de qualité et d’envergure… D’une façon plus générale, la recherche sur la communication de la science n’est pas très développée.

[1] peerreviewcongress.org

[2] Horton R, “Offline : What is medicine’s 5 sigma”, Lancet, 2015, 385:1380.

1 Voir le dossier « Science et médias : une relation sous influence », SPS n° 323, janvier 2018.

Thème : Information scientifique

Mots-clés : Science

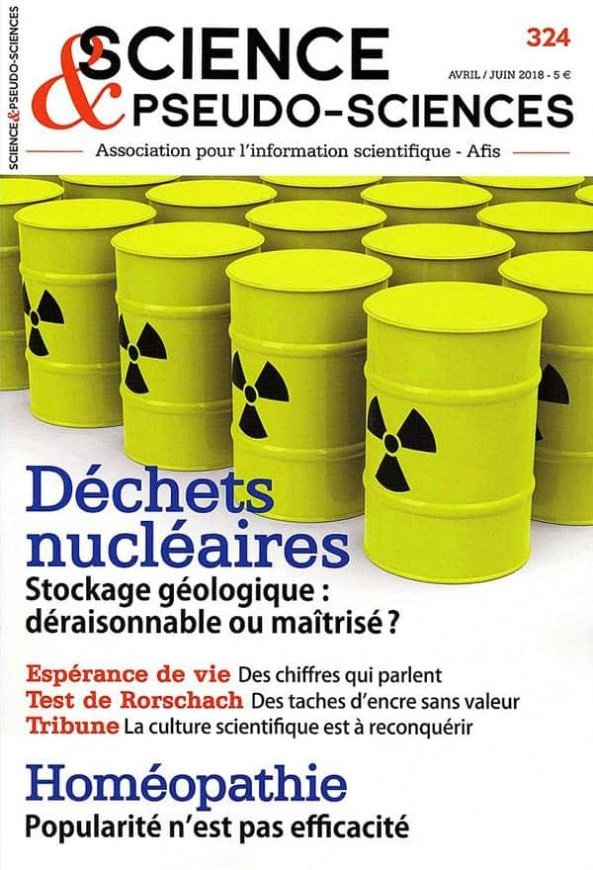

Publié dans le n° 324 de la revue

Partager cet article

L' auteur

Hervé Maisonneuve

Médecin de santé publique, il est consultant en rédaction scientifique et anime le blog Rédaction Médicale et (…)

Plus d'informationsInformation scientifique

Expertise scientifique et décision publique

Le 29 février 2024

Une bactérie immunisée contre les virus

Le 23 octobre 2023

Résistance aux traitements anti-cancer : l’épigénétique a son mot à dire

Le 12 janvier 2023![[12 avril 2022 - Webconférence] Dis, une abeille ça pique ?](local/cache-gd2/56/dd1736a0e6bd6ec181e3b7264a6989.jpg?1681568775)

![[21 mai 2022 - Paris] Épigénétique : existe-t-il une hérédité au-delà des gènes ?](local/cache-gd2/e2/a7103c6cf66de30edffb18ca7d95ec.jpg?1675292140)