Les pièges de l’épidémiologie

Publié en ligne le 8 janvier 2017 - Santé et médicament -

Si l’épidémiologie joue un rôle irremplaçable dans la prise de décision en santé publique et en médecine clinique grâce aux données sur l’état sanitaire, à l’analyse de risques et à l’évaluation des pratiques et de la politique de santé, elle rencontre des difficultés à répondre clairement sur le niveau, voire la réalité, des risques liés à de faibles expositions, en particulier environnementales.

On relève dans ce domaine un grand nombre d’études contradictoires et de faux positifs, du fait, notamment, de l’absence de prise en compte des incertitudes sur les expositions aux facteurs de risques suspectés ou à leurs facteurs confondants, de la multiplication sans précautions des tests statistiques et de la présence de biais incontrôlables.

Introduction

Science de « ce qui s’abat sur le peuple », l’épidémiologie tient un rôle central dans l’analyse quantitative des phénomènes pathologiques touchant une collectivité et dans l’évaluation de la réalité et de l’ampleur de risques avérés ou suspectés. Elle a ainsi une influence majeure sur la prise de décision médicale et sur les orientations des politiques de santé.

Mais la multiplicité des études épidémiologiques aux résultats contradictoires sur les risques sanitaires environnementaux ne peut que désorienter le public et les décideurs. Qu’il s’agisse, par exemple, des champs électromagnétiques de très basse fréquence, des antennes de téléphonie mobile, des téléphones portables, des très faibles doses de rayonnements ionisants, du radon, des pesticides ou des faibles consommations d’alcool, on retrouve en effet un grand nombre d’études dont les résultats sont non seulement contradictoires, mais statistiquement incompatibles.

Ces discordances sont souvent liées à des insuffisances méthodologiques. Certaines relèvent de l’inadéquation des techniques statistiques utilisées pour l’analyse des données recueillies ; elles pourraient être facilement corrigées. D’autres, en revanche, résultent de biais ou de données incomplètes, ce qui obère sans remède la validité des conclusions de l’étude.

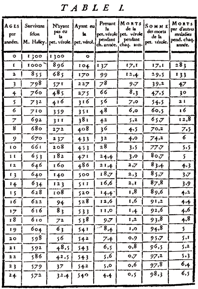

L’approche quantitative des maladies est une discipline ancienne. Le recueil de données de mortalité remonte à 1592, à Londres. En 1760, Daniel Bernoulli publiait le premier modèle des épidémies de variole et montrait l’intérêt de la variolisation (inoculation volontaire sur un sujet sain d’un peu de pus extrait d’une personne atteinte).

Quant à l’épidémiologie clinique, elle est créée par Pierre-Charles Louis, vers 1840, sous le nom savoureux de « médecine numérique » ; prémonition de « l’informatique médicale » ?

Et quand, à Vienne, en 1847, Ignace-Philippe Semmelweis démontre l’intérêt du lavage des mains contre la fièvre puerpérale qui décimait les maternités, c’est aussi une grande victoire de l’épidémiologie descriptive.

Mais ce n’est que dans les années 1950, en particulier grâce à Daniel Schwartz en France, que l’épidémiologie a pris toute sa place, notamment dans les études médicales.

La première force de l’épidémiologie est de partir de questions claires et explicites : quel est le rôle de la distribution de l’eau à Londres dans la propagation du choléra (John Snow 1854) ? Comment expliquer la croissance de l’incidence des cancers du poumon (Sir Richard Doll 1950) ? Combien de victimes fera la variante humaine de la maladie de la vache folle (Alain-Jacques Valleron 2001) ? Comment expliquer la croissance de l’incidence des lymphomes non hodgkiniens (pas encore de réponse… en 2016) ?

Une autre grande force est de recueillir de manière systématique des données sur des effectifs parfois considérables, ce qui permet de lisser de nombreuses particularités individuelles. Il en résulte des études dont la puissance statistique est élevée. Des études plus modestes peuvent parfois être regroupées en « études conjointes » ou « méta-analyses » pour renforcer leur puissance statistique.

Si l’épidémiologie est une science d’observation, son impact sur les pratiques médicales en fait parfois une science expérimentale. Ainsi a-t-on pu suivre aux États-Unis l’impact sur l’incidence du cancer du sein de l’abandon massif des traitements substitutifs de la ménopause.

Avec l’expérimentation biologique et l’expérimentation animale, l’épidémiologie est la troisième et indispensable technique d’étude des grands problèmes de santé. Elle joue un rôle irremplaçable dans la prise de décision en santé publique grâce aux données sur l’état sanitaire (morbi-mortalité), et à l’analyse de risques. Elle est le fondement de l’evidence based medicine (médecine fondée sur les preuves) et donc de la prise de décision en médecine clinique. Enfin, elle permet (ou devrait permettre…) l’élaboration et l’évaluation d’une politique de santé rationnelle et efficace : « un certain nombre de problèmes de très grande importance sociétale se posent, pour lesquels l’épidémiologie mathématique est la seule façon d’apporter des réponses rationnelles » [1].

Faibles expositions :

l’épidémiologie rencontre ses limites

Indispensable, mais ces succès ne doivent pas cacher les difficultés que rencontre l’épidémiologie à répondre clairement sur le niveau, voire la réalité, des risques liés à de faibles expositions comme on les rencontre en particulier dans notre environnement.

Il y a déjà vingt ans, dans l’article de Science intitulé L’épidémiologie rencontre ses limites [2], Gary Taubes constatait le nombre important d’études contradictoires dans ce domaine. Il expliquait que ces faibles risques concernent des populations tellement importantes qu’ils pourraient avoir un impact sanitaire important, mais que de nombreux épidémiologistes admettent que leurs études comportent tellement de biais, d’incertitudes et de faiblesses méthodologiques qu’ils sont incapables de discerner avec précision des risques aussi faibles.

En 2008, dans l’article Les faux-positifs de l’épidémiologie en cancérologie : un appel à la réserve en épidémiologie [3], Paolo Boffetta, épidémiologiste au Centre international de recherche contre le cancer (CIRC, OMS, Lyon), montrait la fréquence des faux positifs et en expliquait les principales raisons.

Incertitudes sur les expositions

Les études environnementales permettent théoriquement d’apprécier le risque qu’une exposition à de faibles doses d’une substance (p. ex. pesticide), d’un procédé technique (p. ex. scanner à rayons X) ou d’un comportement personnel (p. ex. tabagisme) entraîne une pathologie donnée. Elles sont le plus souvent de type cas-témoin, études rétrospectives en cinq étapes (voir encadré).

Une étude cas-témoins se décompose en cinq étapes :

- rassembler un nombre important de cas atteints de la pathologie étudiée ;

- associer à chaque cas un (ou plusieurs) témoin(s) le(s) plus semblable(s) possible au cas (sexe, âge, statut socio-économique...) mais indemne(s) de cette pathologie ;

- évaluer rétrospectivement l’exposition des cas et des témoins au facteur de risque suspecté et à d’éventuels facteurs de risque (dits confondants) susceptibles d’interférer avec le risque suspecté (par exemple le tabagisme pour une étude sur la dangerosité du radon) ;

- comparer les expositions des cas et des témoins au moyen d’un modèle a priori de la relation entre l’exposition et le risque ;

- estimer le risque relatif (RR) du facteur de risque suspecté et l’intervalle de confiance (IC) dans lequel RR a 95 chances sur 100 de se trouver. Par exemple un RR de 2 signifie que les personnes exposées sont deux fois plus souvent atteintes de la pathologie étudiée que les non exposées. On considère qu’un lien est établi entre le facteur de risque suspecté et la pathologie étudiée (étude positive) si la borne inférieure de l’intervalle de confiance est au-dessus de 1.

L’estimation rétrospective de l’exposition aux facteurs de risque repose, quand c’est possible, sur des données objectives (p. ex. mesures), sinon sur des données subjectives (p. ex. interrogatoires) ou sur un « indicateur de l’exposition », donnée censée refléter l’exposition. Cette dernière est ainsi estimée avec un éventuel biais et un certain degré d’incertitude. Ce n’est pas cette incertitude elle-même, inhérente aux sciences d’observation, qui pose problème mais :

- le fait qu’elle n’est pratiquement jamais prise en compte dans l’analyse statistique ;

- dans le cas où un indicateur de l’exposition est utilisé, si l’étude montre un lien entre l’indicateur et la pathologie étudiée, que l’on en déduise sans précaution qu’il y a un lien entre le facteur de risque lui-même et cette pathologie. En effet, une telle conclusion nécessite de tenir compte de la loi de probabilité qui lie l’indicateur au facteur de risque, ce qui n’est pratiquement jamais fait.

Ces erreurs ont pour effet de sous-estimer le risque relatif calculé ainsi que la taille de son intervalle de confiance. Quand l’intervalle de confiance du risque est juste au-dessus de 1, l’étude est considérée comme positive, mais elle ne l’est probablement pas en réalité comme on le montrerait en prenant correctement en compte l’incertitude sur l’exposition.

Sur la fiabilité des indicateurs de l’exposition, on peut citer des exemples caricaturaux comme le nombre de moutons du troupeau comme indicateur de l’exposition de l’éleveur aux insecticides [4], ou l’inverse de la distance aux lignes THT de la maison où est né un enfant comme indicateur de son exposition aux champs électromagnétiques [5].

Un autre exemple est l’étude internationale Interphone sur le risque éventuel de tumeur cérébrale par utilisation du téléphone portable. On savait dès sa mise en œuvre que ce risque, s’il existe, serait très faible car les études antérieures avaient été pratiquement toutes négatives et que, malgré plus d’un milliard d’utilisateurs dans le monde, aucune pathologie n’avait significativement émergé. On avait donc besoin d’une estimation très précise de l’exposition des cas et des témoins, ici le nombre et la durée des appels. Or l’interrogatoire des utilisateurs sur leur consommation téléphonique, utilisé pour Interphone, n’est fiable ni pour la durée ni pour le nombre des appels (voir encadré).

téléphoniques non fiable

Selon les auteurs mêmes d’Interphone : « l’analyse de la concordance entre les données estimées en 2001 par les sujets et celles mesurées par les opérateurs montre une concordance assez médiocre (j = 0,34) mais significative (p < 0,01) pour les nombres moyens d’appels. En revanche, il n’y a aucune concordance entre les durées réelles et les durées estimées au cours du premier entretien (j = 0,18). […] la corrélation entre les nombres [d’appels] estimés et mesurés et plus encore celle des durées est très mauvaise » [6]. Encore, cet interrogatoire a-t-il été conduit en juin 2001 sur les appels d’octobre 2000 à mars 2001 ; qu’en est-il pour les appels datant de plusieurs années utilisés dans Interphone ?

On peut donc se poser la question de la positivité réelle de quelques résultats « positifs » rapportés par certaines études nationales faisant partie d’Interphone. Par exemple, l’étude française [7] rapporte un risque de gliome au-delà de 340 heures d’utilisation du portable avec RR ≈ 1,02 ; IC 95 % = [1,00 / 1,04]. Symétriquement et pour les mêmes raisons, on peut s’interroger sur la réalité de la diminution de 24 % du risque de méningiome qu’assurerait l’utilisation du portable d’après les résultats d’Interphone obtenus pour cinq pays nord-européens [8] avec RR ≈ 0,76 ; IC 95 % = [0,65 / 0,89].

Le piège des sous-groupes

La multiplicité des tests statistiques effectués dans une étude, notamment le test d’une hypothèse sur un nombre important de sous-groupes de la population étudiée, peut conduire, par hasard, à un certain nombre de tests positifs, sources d’incohérences entre les études. La réponse habituelle à cette difficulté est de ne considérer comme avérés que des risques retrouvés par plusieurs études indépendantes. Cette attitude de prudence ne suffit pas à éviter qu’un risque trouvé par une seule étude, donc non confirmé, mais fortement médiatisé, soit considéré comme définitivement démontré par le public et les médecins non spécialistes du domaine. De plus, des techniques de mise en œuvre des tests multiples, comme celle de Holm-Bonferroni [9], évitent de telles conclusions erronées ; elles ne sont malheureusement presque jamais utilisées.

Un exemple est une étude cas-témoins du lien entre vaccination contre l’hépatite B [10] qui concluait au risque de sclérose en plaques (SEP) après vaccination dans le sous-groupe des cas observants pour les vaccinations, avec un délai vaccin-SEP supérieur à trois ans et utilisant un certain vaccin (avec RR ≈ 1,7 ; IC 95 % = [1,03 – 2,95]). Dans ce cas, l’IC est très proche de 1, mais il n’y a guère d’incertitude sur l’exposition (le fait d’avoir été vacciné). En revanche, compte tenu de la multiplicité des sous-groupes, les auteurs ont effectué plus de 150 tests statistiques ; la probabilité d’en obtenir un positif par simple hasard dépasse 90 %.

Facteurs confondants : quelle évaluation ?

Quand un facteur confondant est mal pris en compte, il peut se produire un « transfert de responsabilité » : le risque du facteur confondant étant faussement attribué au facteur de risque étudié. Il en est ainsi, par exemple, dans le cas du tabagisme (facteur de risque majeur) et des études professionnelles ou résidentielles du risque du radon. Dans les études en milieu professionnel, la durée du tabagisme est corrélée avec celle de l’exposition au radon. Il en résulte un « transfert » possible du risque du tabac vers celui du radon. Ceci ne remet pas en cause le risque du radon, mais montre qu’il peut être mal estimé si l’estimation du risque du tabagisme est imprécise.

Les biais d’anamnèse

Les difficultés exposées ci-dessus peuvent être corrigées ou prévenues. Il n’en est pas ainsi des biais d’anamnèse (anamnèse : reconstitution par le patient des antécédents et de l’historique) qui peuvent affecter les études cas-témoins dont l’évaluation rétrospective des expositions repose sur un interrogatoire. Selon les cas, l’exposition peut être alors surestimée (c’est souvent le cas des expositions involontaires, qui peut conduire à des études faussement positives) ou sous-estimée (cas des expositions volontaires).

On peut citer plusieurs exemples : faibles doses d’alcool, consommation alimentaire au moment des retombées de Tchernobyl ou des essais nucléaires, téléphones portables, pesticides. Ces biais sont généralement impossibles à prendre en compte, faute d’une technique objective permettant de les quantifier. Les conclusions de l’étude sont alors invalidées, a fortiori quand les risques mis en évidence sont faiblement significatifs.

On connaît dans ce cadre la supériorité des études de cohortes qui reposent sur le suivi, pendant des années, d’une grande population initialement bien portante. Les futurs cas n’y sont pas influencés par une pathologie à venir, et on dispose d’une quantification objective, régulière des expositions.

Le secret des données

Contrairement à la plupart des publications scientifiques, les données de base des études épidémiologiques sont souvent considérées par leurs auteurs comme une propriété privée, même quand l’étude a été financée par la collectivité. Il en résulte l’impossibilité d’en vérifier les conclusions en reprenant l’analyse statistique avec des techniques appropriées, lorsque cela s’avère justifié. S’il est normal de laisser aux auteurs l’antériorité de la publication de leurs résultats, il serait souhaitable que les données soient accessibles après un délai raisonnable.

Multidisciplinarité

Les publications des revues à comité de lecture devraient faire référence, mais force est de constater la fréquence de celles dont la méthodologie est inappropriée, en épidémiologie ou dans d’autres domaines. Par exemple, l’analyse de 226 publications sur les effets biologiques des radiofréquences dans le rapport 2009 de l’AFSSET (aujourd’hui ANSES) [11] montre que seulement 97 ont une qualité méthodologique suffisante en ce qui concerne les aspects physiques (exposition aux radiofréquences) et biologiques (effet recherché, protocole, etc.) ; toutes, de plus, n’ont pas été validées par une réplication par une équipe indépendante. On ne peut que s’étonner que les 129 autres (près de 60 %) aient passé le filtre de comités de lecture qui ne comportent manifestement pas l’ensemble des compétences que nécessite l’évaluation de recherches intrinsèquement multidisciplinaires.

En épidémiologie, les équipes et les comités de lecture devraient pouvoir maîtriser de nombreuses disciplines (en particulier mathématiques, statistiques, techniques épidémiologiques, métrologie, médecine spécialisée, biologie, sciences humaines et sociales), ce qui n’est pas toujours le cas. Raison de plus pour ne pas sur-interpréter toute étude au résultat insolite et, malgré le battage des médias, pour ne la considérer que comme une piste de travail, en attendant sa confirmation.

Conclusion : pour une échelle de validité des études épidémiologiques

Les insuffisances méthodologiques de nombreuses études épidémiologiques sont souvent évidentes dès leur conception, ce qui ne semble pas obérer leur financement. Ces insuffisances sont souvent discutées dans les manuscrits soumis, comme si les exposer les faisait disparaître, renforçait la validité des conclusions et pouvait transformer une étude erronée en étude publiable.

Il ne faut pas sous-estimer les faiblesses « sociologiques ». Trop d’études cas-témoins rétrospectives sont entreprises pour obtenir un résultat rapide mais beaucoup moins fiable qu’une étude de cohorte en général beaucoup plus longue. Mais la principale faiblesse de l’épidémiologie est le risque de surinterprétation d’études isolées, ce qui peut conduire à des décisions inadaptées.

Pour renforcer l’impact des études épidémiologiques de qualité, heureusement nombreuses et qui contribuent réellement à accroître nos connaissances, il est donc important d’élaborer une échelle de validité des études épidémiologiques, qui évalue prospectivement et rétrospectivement leur fiabilité méthodologique et le degré de preuve qu’elles peuvent apporter. Les professionnels du domaine, les médias, le public, les décideurs et les épidémiologistes ont tout à y gagner.

L’épidémiologie est un domaine scientifique indispensable à la santé publique. L’impact de ses études dont les résultats sont souvent relayés voire amplifiés par les médias lui confère un rôle majeur pour l’orientation des politiques de santé, l’analyse de risque, l’évaluation de la dangerosité et l’acceptabilité des techniques nouvelles. Ce pouvoir implique le devoir d’une grande rigueur méthodologique et d’une interprétation pondérée des résultats.

[1] Valleron A-J. « L’épidémiologie : une science en développement ». Comptes Rendus Biologies 2007, 330:277-80.

[2] Taubes G. “Epidemiology faces its limits”. Science 1995, 269:164-169.

[3] Boffetta P, McLaughlin JK, La Vecchia C, Tarone RE, Lipworth L, Blot WJ. “False-positive results in cancer epidemiology : a plea for epistemological modesty”. J Natl Cancer Inst 2008, 100:988-95.

[4] Rafnsson V. “Risk of non-Hodgkin’s lymphoma and exposure to hexachlorocyclohexane, a nested case-control study”. Eur J Cancer 2006, 42:2781-5.

[5] Draper G, Vincent T, Kroll ME, Swanson J. “Childhood cancer in relation to distance from high voltage power lines in England and Wales : a case-control study”. BMJ 2005, 330:1279-80.

[6] Hours M, Montestrucq L, Arslan M et al. « Validation des outils utilisés pour la mesure de la consommation téléphonique mobile dans l’étude Interphone en France ». Environnement, Risques & Santé 2007, 6:101-109.

[7] Hours M, Bernard M, Montestrucq L et al. « Téléphone mobile, risque de tumeurs cérébrales et du nerf vestibuloacoustique : l’étude cas témoins Interphone en France ». Revue d’Épidémiologie et de Santé Publique 2007, 55:321-332.

[8] Lahkola A, Salminen T, Raitanen J et al. “Meningioma and mobile phone use – a collaborative case control study in five North European countries”. Int J Epidemiol 2008, 37:1304-13.

[9] Holm S. “A simple sequentially rejective multiple test procedure”. Scandinavian Journal of Statistics. 1979, 6 : 65–70.

[10] Mikaeloff Y, Caridade G, Suissa S et al. “Hepatitis B vaccine and the risk of CNS inflammatory demyelination in childhood”. Neurology 2009, 72:870-871.

[11] Rapport d’expertise de l’Agence française de sécurité sanitaire de l’environnement et du travail « Les Radiofréquences », octobre 2009.

Publié dans le n° 318 de la revue

Partager cet article

L' auteur

André Aurengo

André Aurengo, spécialiste des pathologies thyroïdiennes, est professeur de Biophysique à la Faculté de médecine (...)

Plus d'informationsSanté et médicament

Les cosmétiques : réglementés ? utiles ? toxiques ?

Le 20 décembre 2020

Quelle expertise pour quel usage ?

Le 4 mars 2024

Les prescriptions hors autorisation de mise sur le marché

Le 24 février 2024

Baclofène et alcool : la saga atypique d’un médicament

Le 20 février 2024